Melvine LECLERC - Data Strategy & Démarche Data Product

Consultant en Stratégie Data, Cadrage et Product Management, je me spécialise dans le pilotage de transformations numériques au sein d'environnements à haute criticité (Défense, Énergie, Finance). Diplômé de l'EDHEC Business School, je combine une vision business stratégique avec une maîtrise technico-fonctionnelle des architectures de données modernes comme l'IA Générative et les systèmes RAG. Mon parcours est marqué par des interventions critiques, notamment le cadrage du SI logistique d'une ligne de produit majeure pour la défense internationale, ainsi que la conduite d'audits stratégiques. Ma démarche 'Data Product' vise à transformer la technologie en levier de profitabilité et de sécurité pour les grandes organisations.

Expériences Professionnelles

Consultant IT System Strategy - Cadrage SI (Environnements Critiques) chez Acteur majeur de la Défense

Contexte : Dans un contexte de souveraineté et de haute criticité, je suis intervenu pour sécuriser la trajectoire organisationnelle et fonctionnelle d'une transformation SI d'envergure. Ma mission consistait à fournir à la direction les éléments d'arbitrage financiers et opérationnels nécessaires pour engager la phase de réalisation de ce projet structurant pour le cœur de défense.

Compétences : Strategic SI Planning, Risk Management, Financial Modeling (ROM), Python, SQL, Change Strategy, IT Strategy, C-Level Facilitation, Stakeholder Alignment, Data Governance, Audit & Governance, Data Quality

Audit Stratégique & Cartographie Cible

- Réalisation de la cartographie fonctionnelle macroscopique du SI actuel et de la cible organisationnelle.

- Identification et cadrage des interfaces complexes impactant l'architecture et la continuité de service.

- Analyse des matrices d'usage pour définir les périmètres fonctionnels critiques lors de la transition.

Ingénierie de Trajectoire & Macro-planning

- Conception de la roadmap de transition et du macro-planning des livrables stratégiques.

- Modélisation de scénarios de bascule sous fortes contraintes de sécurité et de disponibilité des données.

- Identification et levée des points de blocage organisationnels avant le lancement opérationnel.

Modélisation Économique & Aide à la Décision

- Élaboration d'une estimation budgétaire ROM (Rough Order of Magnitude) pour le chiffrage global du programme.

- Production de matrices comparatives (Coûts / Délais / Risques / Valeur) pour objectiver les choix de la direction.

- Rédaction du dossier de choix final et de la matrice d'arbitrage pour validation de l'investissement par le comité de direction.

Product Owner - Offre Data Product Management chez mc2i

Contexte : En parallèle de mes missions clients, j'assure le rôle de Product Owner pour le développement de l'offre 'Data Product Management' (DPM) au sein de mc2i. Depuis 6 mois, je pilote la formalisation de notre socle méthodologique afin de doter le cabinet d'un cadre de référence robuste, permettant d'accompagner nos clients dans leur transition vers des architectures orientées produits (Data Mesh, Data Fabric).

Compétences : Data Product Management (DPM), Data Governance, Strategic SI Planning, Change Strategy, Agile / Scrum, Stakeholder Alignment, C-Level Facilitation, Data Quality

Gouvernance, Stratégie et Modèles

- Définition des cadres de gouvernance et des stratégies d'alignement métier pour la création de valeur data.

- Modélisation des structures organisationnelles adaptées aux paradigmes Data Mesh et Data Fabric.

- Structuration des indicateurs de ROI et de performance stratégique pour les portefeuilles de produits de données.

Modèle Opérationnel & Delivery

- Industrialisation du modèle opérationnel : de la phase de Discovery à l'intégration continue (Run).

- Intégration des standards de Data Quality et des principes FinOps au cœur du cycle de vie des produits.

- Définition des matrices de rôles et responsabilités (Data Product Manager, Data Steward, Data Engineer).

Change, Agilité & Adoption

- Création de stratégies d'acculturation et d'adoption pour maximiser l'usage des produits data par les métiers.

- Intégration des méthodologies Agiles et des principes UI/UX dans la conception des interfaces de restitution.

- Développement de mécanismes de gamification pour lever les freins au changement au sein des organisations.

Consultant Data Strategist - Audit, Gouvernance & Business Intelligence chez Gestionnaire du Réseau de Transport d'Électricité

Contexte : Suite à la livraison d'un siège régional majeur, j'ai été missionné par la Direction de Projet pour piloter un audit et un retour d'expérience (REX) stratégique. L'enjeu était de produire un diagnostic financier et opérationnel de haute précision, capable de répondre aux exigences de l'autorité de régulation et de servir de socle décisionnel pour de futurs projets de campus d'envergure.

Compétences : Python, Audit & Governance, PowerBI, Excel / VBA, Change Strategy, Vendor Management, Stakeholder Alignment, Financial Modeling (ROM), Data Quality, Risk Management, SQL, Data-Driven Analysis

Data Engineering & Audit BI

- Extraction et structuration de données critiques issues de 273 fichiers PDF (Fiches de Travaux) et de dossiers budgétaires.

- Nettoyage et curation du dataset sous Python : harmonisation des champs, gestion des données manquantes et création de clés primaires pour jointures complexes.

- Développement de la fonctionnalité Rejouer le match sous Power BI : interface interactive permettant d'analyser dynamiquement les scénarios de dépenses passés.

Gouvernance & Conformité Réglementaire

- Audit des budgets et des engagements contractuels en vue de la justification des coûts auprès des instances de régulation.

- Production de visualisations statistiques (MatPlotLib) : Chandeliers additifs et régressions sur les coûts pour objectiver les variations budgétaires.

- Sécurisation de la qualité de la donnée (Data Trust) pour garantir la fiabilité des rapports présentés en Comité de Pilotage.

Management de Projet & Change

- Accompagnement du Directeur de Projet dans l'identification des irritants organisationnels et des succès opérationnels.

- Formalisation des leçons apprises et recommandations stratégiques pour l'optimisation des processus de gestion de projet au niveau national.

- Accompagnement au changement via la création de KPIs de performance et la formation des équipes aux nouveaux outils de pilotage.

Data Product Lead - AI Strategy for Banking Operations chez mc2i

Contexte : Face au flux massif d'opportunités émises par un Leader Européen du Secteur Bancaire, j'ai piloté la création d'un moteur de préqualification intelligent. Ce produit 'Data-Driven' utilise des algorithmes de NLP et de Machine Learning pour transformer un processus manuel complexe en un avantage compétitif automatisé, sécurisant ainsi les arbitrages de la direction technique et commerciale.

Compétences : Data Product Management (DPM), Agile / Scrum, Natural Language Processing (NLP), Change Strategy, LLM / RAG, Generative AI, Machine Learning Ops, Python, PowerBI, SQL, Stakeholder Alignment, Data-Driven Analysis, Data Quality, Vector Databases, Full Stack

Product Discovery & Vision Stratégique

- Animation d'ateliers de co-conception avec les directions commerciale et technique pour définir la roadmap et le MVP (Minimum Viable Product).

- Traduction des besoins stratégiques en Epics et User Stories à haute valeur ajoutée métier.

- Modélisation de la valeur produit et priorisation du backlog basée sur l'impact financier et la faisabilité technique.

Agile Delivery & Technical Leadership

- Pilotage opérationnel des rituels Scrum et facilitation de la collaboration entre développeurs et parties prenantes.

- Garantie de l'intégrité fonctionnelle des livrables IA et validation de la conformité des algorithmes de scoring.

- Arbitrage technique et fonctionnel lors des phases de développement pour maintenir la vélocité de l'équipe.

Growth, Adoption & ROI

- Architecture et suivi des KPIs de performance (précision du modèle, taux d'adoption, gains de productivité).

- Conduite du changement et déploiement de la solution auprès des équipes de vente pour maximiser l'usage.

- Analyse continue des feedbacks utilisateurs pour alimenter le backlog stratégique et planifier les futures itérations du produit.

Project Lead - Transformation Digitale & Data Operations (Agile) chez Acteur de l'Économie Sociale et Solidaire

Contexte : Dans le cadre de la transformation digitale d'un acteur engagé de l'ESS, j'ai dirigé une équipe technique pour concevoir des solutions métiers automatisées destinées aux départements finance et production. Ma mission a consisté à orchestrer la transition vers des outils digitaux agiles, assurant ainsi une meilleure efficacité opérationnelle et une aide à la décision basée sur la donnée pour le comité stratégique.

Compétences : Agile / Scrum, Python, SQL, Change Strategy, PowerBI, Stakeholder Alignment, Data Quality, Data-Driven Analysis, Data Product Management (DPM), Data Governance, Audit & Governance

Méthodologie Agile & Discovery

- Traduction des besoins métiers complexes en spécifications techniques et User Stories actionnables.

- Animation des rituels Agiles et priorisation du backlog pour maximiser la valeur délivrée à chaque itération.

- Cadrage fonctionnel et définition des indicateurs clés de performance (KPI) pour les nouveaux outils digitaux.

Leadership Technico-Fonctionnel

- Interface permanente entre les équipes de développement et les directions métiers pour garantir l'alignement des solutions.

- Coordination des ressources internes et suivi rigoureux du planning et de l'enveloppe budgétaire.

- Accompagnement au changement pour assurer l'adoption des nouveaux processus par les utilisateurs finaux.

Data Governance & Support Stratégique

- Architecture de tableaux de bord Power BI pour le suivi en temps réel de la performance industrielle et financière.

- Gestion d'un service de support critique avec mise en place de recommandations d'amélioration continue du SI.

- Capitalisation sur les données de production pour renforcer la performance opérationnelle globale.

Consultant Strategy & Change - Facilitateur Executive Workshop chez Leader des Services Multi-techniques

Contexte : Dans le cadre d'une transformation organisationnelle majeure, j'ai été missionné pour concevoir et animer un séminaire stratégique d'accompagnement au changement destiné au CODIR DSI. L'objectif était d'aligner la vision des dirigeants sur les enjeux de transformation numérique et de sécuriser l'adoption des nouveaux modèles opérationnels par le top management.

Compétences : C-Level Facilitation, Change Strategy, Stakeholder Alignment, Data-Driven Analysis, IT Strategy, Python, Excel / VBA, Data Quality

Diagnostic & Alignement Stratégique

- Recueil des besoins critiques et analyse des metrics projets auprès de la direction IT.

- Synthèse des points de blocage organisationnels via une approche qualitative et quantitative.

Ingénierie de l'Intervention (Workshop Design)

- Élaboration d'un programme d'ateliers interactifs combinant cas pratiques et coaching stratégique.

- Développement de supports pédagogiques à forte valeur ajoutée, adaptés aux enjeux 'Data-Oriented' du secteur IT.

Facilitation Executive & Mesure d'Impact

- Animation en direct des sessions de travail auprès des membres du CODIR DSI.

- Évaluation de l'efficacité du dispositif et de l'adhésion des leaders via un protocole de feedbacks structuré.

Consultant Stratégie IT & Data - Pilotage d'Appel d'Offres chez Leader de la Promotion Immobilière

Contexte : Dans le cadre de la transformation des SI d'un acteur majeur de l'immobilier, j'ai piloté la conception et l'organisation de l'appel d'offres pour la sélection d'un partenaire d'infogérance stratégique. Mon objectif était de définir un cadre fonctionnel et technique agile garantissant la continuité des services IT tout en optimisant la structure de coûts à long terme.

Compétences : Python, Excel / VBA, Financial Modeling (ROM), IT Strategy, Vendor Management, C-Level Facilitation, Stakeholder Alignment, Data-Driven Analysis, Change Strategy, Data Quality, Strategic SI Planning, Audit & Governance

Cadrage Stratégique & Analyse des Besoins

- Audit des besoins critiques auprès des directions DSI et métiers.

- Définition des indicateurs de performance (KPI) et de qualité de service attendus.

- Rédaction du dossier de consultation des entreprises (DCE).

Gouvernance de l'Appel d'Offres

- Coordination des interactions avec les prestataires et gestion du flux d'information.

- Animation des soutenances et des phases de négociation technique.

- Sécurisation du processus de contractualisation.

Analyse Économique & Aide à la Décision

- Construction d'un modèle financier sous Python/Excel pour comparer le TCO (Total Cost of Ownership) des offres.

- Réalisation de matrices d'arbitrage (Coûts / Risques / Valeur) pour le comité de direction.

- Accompagnement au changement pour l'alignement de la stratégie IT sur les exigences métiers.

Data Product Lead - GenAI & Knowledge Strategy chez Talisker Consulting

Contexte : Dans le cadre de la transformation digitale du cabinet, j'ai piloté la création d'un produit d'IA Générative souverain. L'objectif était d'industrialiser l'accès à des décennies de savoir-faire interne en développant une architecture RAG capable de traiter des volumes massifs de données tout en garantissant une confidentialité totale (Zero-Cloud).

Compétences : LLM / RAG, Natural Language Processing (NLP), Generative AI, Vector Databases, Full Stack, Data Product Management (DPM), Machine Learning Ops, Data Governance, Data-Driven Analysis, Excel / VBA, Python, SQL, Stakeholder Alignment, Change Strategy, Data Quality

Product Discovery & IA Strategy

- Audit de l'existant et définition des exigences de sécurité pour une solution d'IA Privacy-first.

- Conception du système de Workspace par session pour gérer des contextes larges et des mémoires spécifiques par domaine d'expertise.

- Modélisation de la valeur d'usage pour aligner les capacités du LLM sur les besoins réels des consultants en mission.

Technical Product Engineering

- Construction de la chaîne d'ingestion : conversion automatisée (.md), chunking sémantique et stockage dans une VectorDB locale (Python).

- Développement du backend (Uvicorn/FastAPI) et de l'interface frontend, intégrés via un pont SSH sur serveur WSL (Nvidia RTX 3080 Ti).

- Finetuning des fonctions d'activation et de récupération vectorielle pour maximiser la pertinence des réponses générées.

Adoption & Gouvernance de la Donnée

- Déploiement en production et mise en place d'un dispositif de suivi pour l'optimisation continue de la base vectorielle.

- Formation des utilisateurs finaux à l'exploitation de la solution et à la capitalisation des savoirs via l'IA.

- Établissement de protocoles de Data Quality pour garantir la fraîcheur et la véracité des connaissances ingérées.

Projets Data & Tech

DEIMOS - Terminal Quantitatif & Trading Temps Réel

Résumé : Conception et développement Full Stack d'un terminal de marché haute performance (60 FPS), intégrant des flux WebSockets live, des Web Workers pour l'analyse technique, et un moteur d'optimisation paramétrique.

DEIMOS est une plateforme quantitative conçue pour rivaliser avec les standards des terminaux institutionnels. L'enjeu majeur de ce projet réside dans la gestion de la haute fréquence et le maintien absolu de la fluidité de l'interface (60 FPS) lors de l'ingestion de flux de prix en direct.

*Interface réactive avec flux WebSockets live et gestion du P&L (Portfolio Management) en direct.*

**Architecture Backend (Asynchrone & Concurrence)**

Le cœur du système est motorisé par FastAPI et Uvicorn. Pour résoudre le problème des verrous d'écriture lors du streaming de données WebSocket, la base de données SQLite implémente une architecture SST (Single Source of Truth) configurée avec le pragma `journal_mode=WAL` (Write-Ahead Logging). Cela permet des lectures et écritures non bloquantes, essentielles pour un flux de marché ininterrompu.

*Fluidité absolue à 60 FPS maintenue grâce au déchargement des calculs vectoriels sur Web Workers.*

**Architecture Frontend (Heavy Client & Off-Thread Computing)**

L'interface en React/Vite s'appuie sur `lightweight-charts` pour le rendu canvas. La véritable innovation réside dans le déchargement du thread principal (V8) : l'intégralité de la lourde charge mathématique (calcul vectoriel de 19 indicateurs sur des milliers de bougies) est isolée dans des Web Workers dédiés (`calculation.worker.js`).

*Ajustement algorithmique automatique des paramètres d'indicateurs via le moteur d'optimisation.*

**Moteur d'Optimisation (Smart A.I.)**

DEIMOS intègre un module de 'Shadow Back Compute' capable de brute-forcer les meilleurs paramètres d'un indicateur sur un actif donné (ex: trouver la période EMA optimale pour obtenir 85% de win-rate sur un an).

Stack : Python (FastAPI), React (Vite), WebSockets, Web Workers, SQLite (WAL / SST), Quantitative Analysis, Lightweight Charts, Zustand State

Moteur Quantitatif & Bibliothèque d'Indicateurs

- Développement 'from scratch' de 19 indicateurs techniques vectorisés en JavaScript pour l'exécution côté client.

- Programmation d'indicateurs de Tendance (SMA, EMA, WMA, HMA, VWMA, DEMA, TEMA, ZLEMA, KAMA, McGinley Dynamic) et de Volatilité (Bollinger, Keltner, Donchian, Envelope, STARC).

- Architecture de calcul 'Resolution-Based Independence' (RBI) permettant de projeter des métriques macro (ex: Daily) sur des vues micro (ex: 1m).

Data Streaming & Performance (60 FPS)

- Implémentation d'une flotte de Web Workers pour isoler le calcul des tableaux mathématiques, prévenant tout 'UI Freeze' lors de l'application d'indicateurs lourds.

- Création d'un gestionnaire de WebSockets broadcastant les 'Ticks' de prix en temps réel sur des canaux spécifiques et globaux.

- Synchronisation intelligente de l'état (Zustand) évitant la reconstruction complète de l'arbre DOM à chaque variation de prix (Flicker-free updates).

Portfolio Management System (DPMS) & Smart Features

- Développement d'un simulateur de portefeuille temps réel : calcul de l'Equity, de l'Unrealized P&L et gestion du Cash Flow dynamiquement indexé sur le flux WebSocket.

- Conception d'une API d'optimisation paramétrique (Smart A.I.) déterminant automatiquement les paramètres maximisant l'efficacité d'un indicateur.

- Système de 'Watchlists' hiérarchiques avec persistance SQLite asynchrone et mise à jour des variations en background sync.

Impact des Chatbots IA sur l'Expérience Client - Mémoire de Master

Résumé : Analyse quantitative approfondie de l'impact des agents conversationnels sur l'engagement utilisateur et la satisfaction client dans le secteur B2C en France.

Ce mémoire de recherche explore le décalage entre l'omniprésence technologique des chatbots IA et leur impact réel sur l'expérience client (CX).

**Cadre Théorique & Conceptuel**

L'étude s'appuie sur la **Théorie Bifactorielle de Herzberg** pour distinguer les facteurs d'hygiène (comme la rapidité) des facteurs de motivation (efficacité, confiance). Elle mobilise également les modèles d'acceptation technologique (TAM/UTAUT) pour évaluer l'utilité et la facilité d'usage perçues .

**Résultats Majeurs**

Les analyses démontrent que la rapidité est perçue comme un prérequis (hygiène) n'augmentant pas la satisfaction, tandis que l'efficacité de résolution est le levier principal de recommandation. L'étude révèle également une forte dépendance au contexte, la préférence pour l'humain restant massive dès que la complexité de la tâche augmente.

Stack : Artificial Intelligence, Quantitative Analysis, Python (Pandas/SciPy), Customer Experience (CX), AI Chatbots, Inferential Statistics, B2C Strategy

Méthodologie & Collecte de Données

- Conception et diffusion d'un questionnaire psychométrique via Qualtrics (N=98).

- Opérationnalisation des variables : engagement (cognitif, affectif, comportemental) et dimensions de la CX.

- Nettoyage et préparation des données (Data Cleaning) avec la bibliothèque Pandas.

Analyse Statistique & Modélisation

- Réalisation de régressions linéaires et logistiques pour tester les hypothèses d'influence sur la satisfaction et la fidélité.

- Analyse de médiation (Baron & Kenny) pour valider le rôle central de la satisfaction entre performance et recommandation.

- Tests de comparaison de moyennes (Welch) et de proportions (McNemar) pour évaluer l'impact de la complexité des tâches.

Le Père Noël est-il un Rocker ? - Directeur de Production

Résumé : Direction de production d'un festival de musique solidaire historique rassemblant 5000 festivaliers. Gestion d'une équipe de 50 personnes et d'une flotte logistique complexe pour offrir des jouets à 3000 enfants défavorisés.

Le festival « Le Père Noël est-il un Rocker ? » est un événement caritatif majeur de la Métropole Européenne de Lille (MEL) reposant sur un concept simple : 1 place de concert achetée = 1 jouet offert = 1 enfant heureux.

**Gestion Logistique et Négociation Contractuelle**

En tant que Directeur de Production, l'enjeu principal était d'assurer la viabilité, le financement et la sécurité de l'événement. Cela a impliqué la négociation et la gestion de contrats critiques couvrant l'ensemble des besoins du festival : location et sécurisation des salles, catering pour les équipes et artistes, location du backline, déploiement des dispositifs de sécurité et de secours, ainsi que les assurances événementielles.

**Management des Équipes et Coordination sur Site**

Le bon déroulement du festival reposait sur une organisation humaine millimétrée. J'ai encadré et dirigé une équipe de 50 staffeurs sur le terrain, assurant la répartition des tâches, la gestion des flux de public et la résolution d'incidents en direct. Une flotte de 15 véhicules (runners) a été déployée et coordonnée pour garantir les transferts des artistes, du matériel technique et des équipes entre les gares, hôtels et salles de concert.

**Gestion des Artistes et Régie**

Au-delà de l'infrastructure globale, la dimension artistique nécessitait un accompagnement continu des groupes programmés. De l'accueil (hospitality) à la gestion des fiches techniques (riders) en passant par la régie plateau, l'objectif était de fournir des conditions de performance optimales aux artistes tout en respectant les contraintes budgétaires strictes inhérentes à un festival associatif étudiant.

Stack : Direction de Production, Logistique Événementielle, Management d'Équipe, Négociation Contractuelle, Régie Artistique, Gestion de Projet, Associatif / Caritatif

Négociation & Gestion Contractuelle

- Négociation des devis et gestion des prestataires techniques et logistiques (Catering, Backline de scène, location de la flotte de véhicules).

- Contractualisation avec les salles de concert de la Métropole Lilloise et gestion des assurances (Responsabilité Civile Organisateur).

- Mise en place et supervision des dispositifs de sécurité (agents) et de secours médicaux sur site, en stricte conformité avec les réglementations.

Management des Opérations & Logistique

- Recrutement, formation et supervision d'une équipe de 50 staffeurs pour le bon fonctionnement et la fluidité des soirées de festival.

- Création d'un planning de rotation et coordination en temps réel d'une flotte de 15 runners véhiculés (déplacements urgents, transferts artistes/matériel).

- Supervision des plannings de montage (get-in) et de démontage (load-out) des infrastructures sur les différents sites de l'événement.

Accueil Artistes & Régie

- Analyse des fiches techniques (Riders) des artistes et adaptation du matériel en fonction des contraintes de chaque salle.

- Gestion globale de l'accueil, de l'hébergement, du catering et des transferts des groupes de musique et de leur entourage.

- Coordination entre les équipes artistiques et les équipes techniques (ingénieurs son et lumière) pour garantir la qualité optimale des concerts.

Portfolio Personnel - Architecture 'Data-as-Code'

Résumé : Développement d'une plateforme Full Stack pilotée par la donnée, illustrant une approche Single Source of Truth (SSOT).

Ce projet est la concrétisation technique de ma méthodologie : traiter le contenu comme du code. L'architecture repose sur un monorepo découplé (FastAPI / React) où chaque expérience et projet est géré comme une entité de donnée structurée, validée par des schémas rigoureux et servie via une API stateless.

**Rigueur Méthodologique**

L'ensemble du contenu est centralisé dans une base de données SQLite, hydratée dynamiquement à partir de fichiers de configuration JSON. Cette approche garantit l'intégrité des données et permet une scalabilité immédiate du contenu sans modification du code source (Pattern SSOT).

**Architecture Technique**

Le backend FastAPI assure la validation automatique des données via Pydantic, tandis que le frontend React (Vite) offre une interface Single Page Application (SPA) fluide. Le design system est volontairement minimaliste, inspiré des environnements de développement (IDE), pour mettre en avant la clarté et l'efficacité de l'information (Breathing UI).

**Déploiement & Industrialisation**

L'infrastructure est orchestrée via Vercel, faisant le pont entre les fonctions Python asynchrones et le build statique optimisé du frontend. Le projet intègre des patterns de développement avancés : custom hooks pour la gestion d'état, proxying API, et filtrage dynamique complexe.

Stack : FastAPI, React, Data-as-Code, Python, SQLite, Vite, Architecture Stateless, CI/CD Vercel

Architecture & Data Engineering

- Modélisation de la base de données SQLite et création de scripts d'auto-hydratation (init_db).

- Conception d'une API Stateless avec FastAPI et validation de schéma via Pydantic.

- Mise en place d'une architecture Single Source of Truth (SSOT) via fichiers JSON structurés.

Frontend Engineering & UX

- Développement d'une SPA sous React avec une gestion d'état centralisée par Custom Hooks (usePortfolioData).

- Création d'un Design System 'IDE-inspired' (JetBrains Mono, Inter) avec support natif du mode sombre.

- Implémentation d'un moteur de filtrage dynamique transverse basé sur les tags et les compétences.

DevOps & Déploiement

- Configuration du routing Vercel pour l'orchestration multilangage (Python/Node.js).

- Mise en place d'un workflow de développement rigoureux avec proxying API et rechargement à chaud.

- Optimisation des performances (Vite, bundling) et de l'accessibilité web.

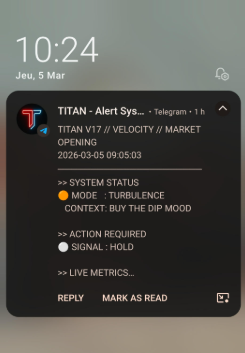

TITAN - Système Quantitatif & Trend Following

Résumé : Développement d'un algorithme de trading systématique avec moteur de backtest vectoriel, interface de suivi Streamlit et alerting Telegram.

TITAN (itération V17) est un système de trading algorithmique conçu pour systématiser une stratégie de suivi de tendance (Trend Following). Le projet intègre le calcul des signaux, la gestion de l'exposition et le monitoring du portefeuille.

*Interface de suivi développée avec Streamlit et stylisée en CSS.*

**Logique d'investissement**

La stratégie repose sur l'exploitation de l'autocorrélation (Momentum) des séries temporelles. L'algorithme ajuste dynamiquement l'exposition sur des ETF à levier en s'appuyant sur des filtres de régime de marché (moyennes mobiles, pente stochastique, volatilité).

**Moteur de backtest**

Le script de simulation, développé en Python (Pandas/NumPy), modélise le comportement historique d'actifs. Il intègre notamment la reconstruction mathématique des ETF à levier pour évaluer précisément l'impact du Beta Decay, du spread et des taux d'intérêt (^IRX).

*Visualisation de l'Equity Curve et des métriques de risque.*

**Alerting et Monitoring**

Afin de limiter l'intervention manuelle au strict nécessaire, l'état du système est communiqué via des notifications Telegram (calcul du PnL journalier, signaux d'ouverture/fermeture, prédiction de gap).

*Rapports de routine générés par l'API Telegram.*

Stack : Python, Streamlit, Finance Quantitative, Pandas / Numpy, Docker, Telegram API, Plotly

Recherche et Modélisation

- Développement d'un algorithme de filtrage de tendance combinant des moyennes mobiles (longues et courtes) pour la détection de régime.

- Reconstruction d'historiques synthétiques pour ETF à levier, simulant les frottements (Beta Decay, taux directeurs FED).

- Calcul des métriques de performance et de risque standardisées : CAGR ajusté (TWR), Ratio de Sharpe/Sortino, Ulcer Index et Max Drawdown.

Ingénierie des Données et Backend

- Extraction et consolidation de données de marché journalières et intra-day via l'API yfinance.

- Conception d'un module de persistance locale (JSON/CSV) pour la sauvegarde de l'état du portefeuille et des flux de trésorerie.

- Mise en place d'un algorithme de calcul FIFO pour le suivi précis du PnL réalisé et de la durée de détention des positions.

Développement Interface (Streamlit)

- Création d'un tableau de bord de suivi via Streamlit, avec injection de CSS personnalisé pour l'interface.

- Développement d'un mécanisme d'authentification par token rotatif pour restreindre l'accès à l'interface de production.

- Intégration de graphiques interactifs Plotly (Equity Curve, distribution des rendements, Heatmaps mensuelles).

Déploiement et Automatisation

- Conteneurisation de l'application (Docker, Docker Compose) pour un déploiement continu sur serveur VPS.

- Développement de scripts de vérification pour rapprocher les prix d'exécution simulés des conditions réelles du marché.

- Intégration de l'API Telegram pour le routage asynchrone des signaux de trading et des bilans de performance.

> Chargement de l'interface interactive...